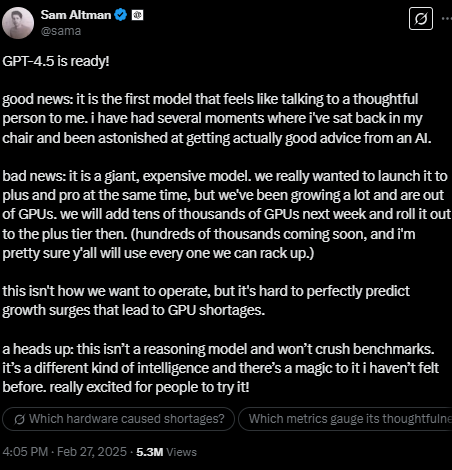

El esperado modelo GPT-4.5 de OpenAI tendrá un lanzamiento escalonado, no por limitaciones de software, sino porque la empresa se ha quedado sin GPUs, según su CEO, Sam Altman.

En una publicación en X, Altman reveló que GPT-4.5, al que describió como “gigantesco” y “costoso”, requerirá decenas de miles de GPUs adicionales antes de que OpenAI pueda ampliar el acceso. Inicialmente, el modelo estará disponible para suscriptores de ChatGPT Pro a partir del jueves, y los usuarios de ChatGPT Plus lo recibirán la próxima semana.

Por qué GPT-4.5 es tan costoso

Debido a su gran tamaño y alta demanda de procesamiento, GPT-4.5 tiene un costo considerable. OpenAI ha establecido los siguientes precios:

- $75 por cada millón de tokens de entrada (~750,000 palabras)

- $150 por cada millón de tokens generados

Esto representa un costo 30 veces mayor en entrada y 15 veces mayor en salida en comparación con GPT-4o, el modelo comercial principal de OpenAI.

“Hemos crecido mucho y nos hemos quedado sin GPUs”, escribió Altman. “Añadiremos decenas de miles de GPUs la próxima semana y lo lanzaremos en el nivel Plus entonces… No es así como queremos operar, pero es difícil predecir perfectamente los aumentos de demanda que conducen a la escasez de GPUs.”

El plan de OpenAI para solucionar la escasez de GPUs

No es la primera vez que Altman menciona las limitaciones de hardware como un obstáculo para el crecimiento de OpenAI. La compañía está buscando soluciones para garantizar la escalabilidad de sus modelos, incluyendo:

- Desarrollar sus propios chips de IA para reducir la dependencia de proveedores externos.

- Construir una amplia red de centros de datos para aumentar su capacidad de cómputo.

Con la creciente demanda de IA y la escasez global de GPUs, la capacidad de OpenAI para expandir su infraestructura será clave para su dominio a largo plazo en el sector de la inteligencia artificial, reporta TechCrunch.